AI专家之路-2-DeepSeek-v3 & DeepSeek-r1

DeepSeek-v3(基础模型)

主要用于直接生成最终答案或结论,侧重于快速响应用户的查询。适用于大多数任务,侧重语言生成、上下文理解和自然语言处理,而不强调深度推理能力。此类模型通常通过对大量文本数据的训练,掌握语言规律并能生成合适的内容,但缺乏像推理模型那样复杂的推理和决策能力。

如GPT-3、GPT4,BERT等,主要用于语言生成、语言理解、文本分类、翻译等任务。

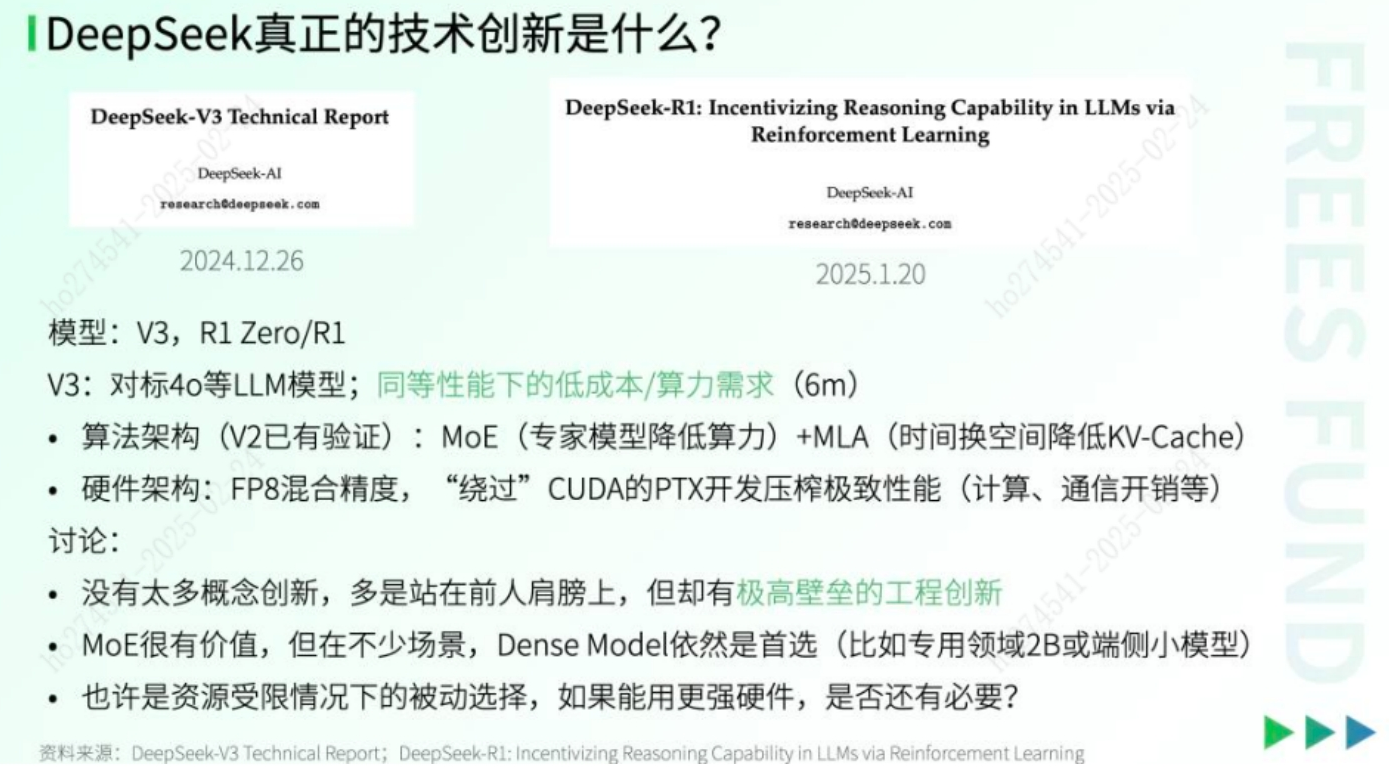

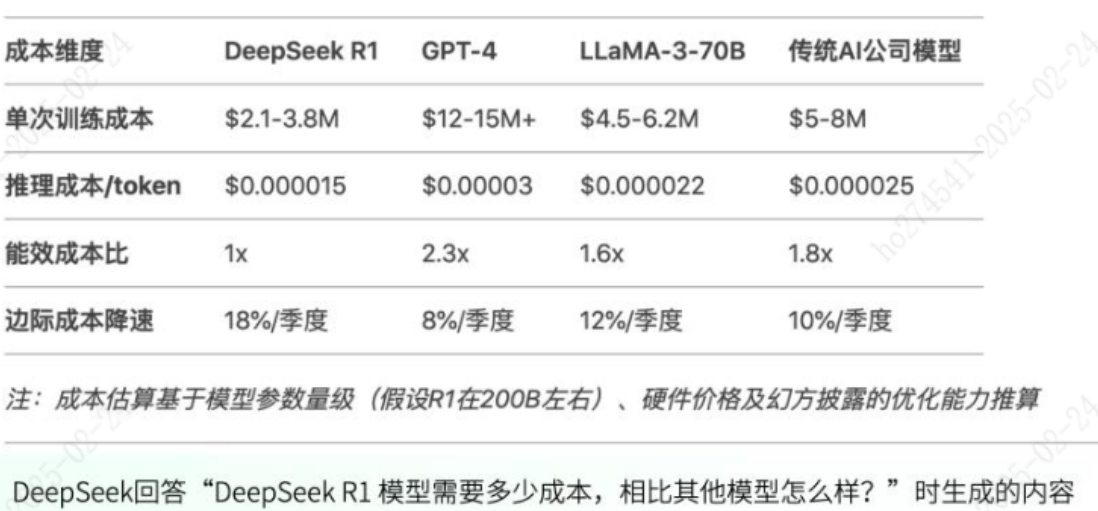

DeepSeek V3在V2的版本上,进一步强化了降本增效的能力。V3相当于是对标OpenAI GPT4o的预训练大模型,它以极低的算力成本,实现了和其他模型同等甚至表现更好的结果。软件架构上的创新主要有MOE和MLA。

MoE(Mixture of Experts,专家混合模型):2023年,法国AI公司Mistral AI最早大规模开源MoE模型,它曾经推出Mixtral 8x7B模型,采用了8个专家,每次推理时激活其中的2个专家。

DeepSeek则增加了专家数量,缩小了每个模型的规模。虽然单个专家性能有所下降,但整体性能却因“人多力量大”而提升。具体来说,DeepSeek的MoE架构把前向推理网络划分成了1个共享专家以及256个独立专家。模型每次预测的时候,只会激活共享专家以及另外256个专家中的8个专家,大大降低了算力消耗。

此外,DeepSeek还在训练过程中通过偏离函数,调整专家负载,避免出现“强者越强,弱者越弱”的马太效应。

Dense Model(单一专家模型):也有优势,比如面向B端的专用领域或者端侧小模型。所以,我们也不能完全下定论,认为MoE未来就会“一统江湖”。大家有各自不同的模型架构,选择的应用场景也不同。

MLA(Multi-head Latent Attention,多头潜在注意力):是DeepSeek成为“价格屠夫”的核心技术之一,这种方法是“用时间换空间”。大模型推理离不开Attention计算,而Attention计算中,KV缓存(Key-Value 缓存)是主要的存储开销。在Transformer模型的自注意力机制中,输入元素会被转换成查询(Query)、键(Key)和值(Value)这三种类型。KV 缓存就是在推理过程中,把先前步骤计算得到的 Key 和Value矩阵缓存起来,避免在生成新token时重复计算整个序列的Key和Value。

DeepSeek通过矩阵分解的方法,将KV缓存压缩后再投影回高维空间,从而大幅降低了存储开销。这种技术原理简单但非常有效,实现了推理价格骤降。

MOE和MLA结合在一起,降低了模型对硬件算力和显存带宽的需求,因此,DeepSeek让整体成本下降了一个数量级。

混合精度框架(硬件架构上的创新):用低精度的FP8(即8位浮点数表示法,是一种用于提高计算效率和动态范围的数据格式)做了大量的计算工作。再比如,通过大量PTX(Parallel Thread Execution,是NVIDIA为其GPU设计的一种并行指令集架构)的底层开发能力,“压榨”硬件的性能,来降低计算和通信的开销。

DeepSeek-r1(推理模型)

能够展示出完整的思维流程,包括如何从初始信息逐步推导至最终结论,对于需要详细解析的问题尤为适用。指能在传统的大语言模型基础上,强化推理、逻辑分析和决策能力的模型它们通常具备额外的技术,如强化学习、神经符号推理、元学习等,来增强其推理和问题解决能力。

如DeepSeek-r1,GPT-o3等,在逻辑推理、数学推理和实时问题解决方面表现突出。

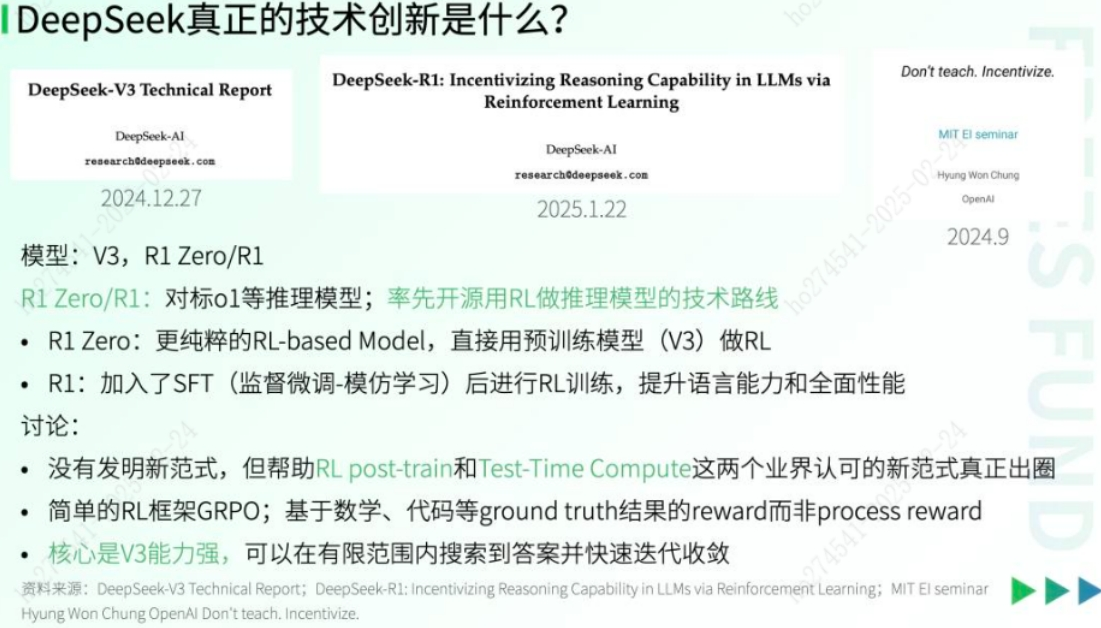

前身是大语言模型LLM,基于DeepSeek-V3,不使用SFT(监督微调),完全通过强化学习(RL)进行大模型训练。

l 模型通过与环境交互并以奖励或惩罚方式获得反馈来进行学习,即反复试错来进行教学,生成答案评估质量,调整自身行为以改进未来表现

l 具备强大推理能力,自我验证答案,对之前输出反思并不断改进,通过延展思维链CoT(Chain of Thought),像人,分解问题成多步骤,逐步推导。

GPRO模型:群组相对了策略优化,不需要单独的值网络作为评论家,用多模平均值替代。PRO依赖:行为者+评论家+裁剪+KL惩罚框架。

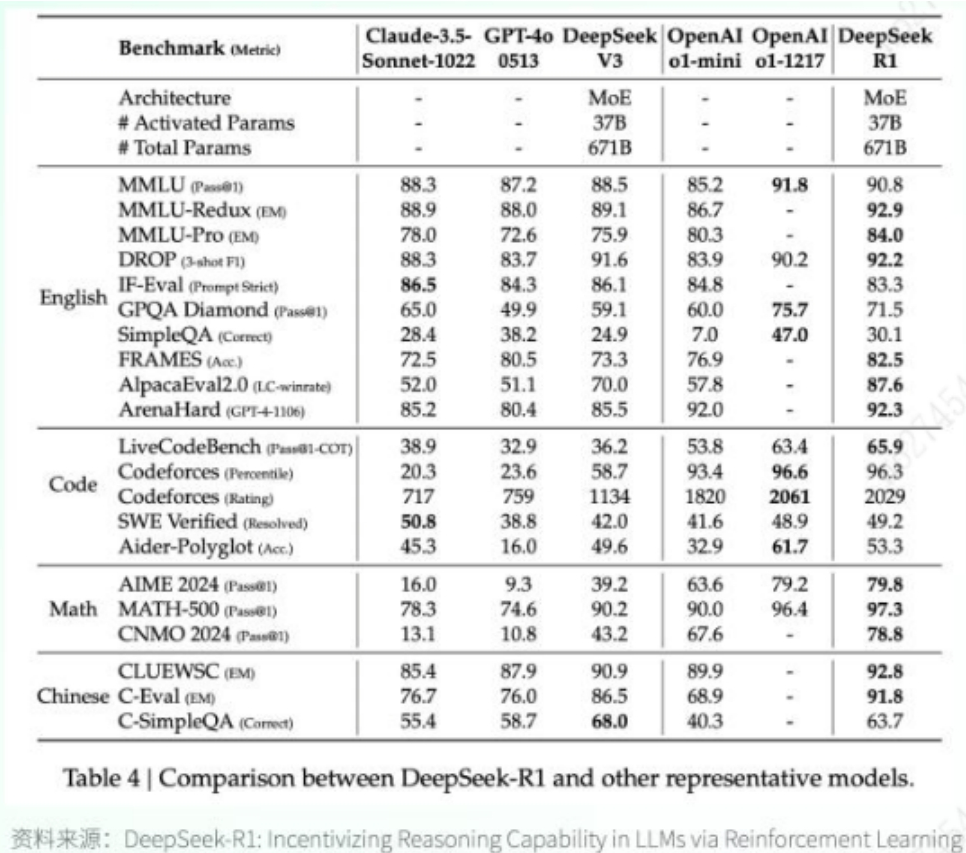

R1 Zero和R1,它们是对标OpenAI o1系列的推理模型。DeepSeek发布了R1,实实在在地通过自己的探索,用强化学习实现了比肩o1的推理大模型,并开源了相关的工作,非常厉害。从我们的观察来看,强化学习是通向AGI的一个递进路径,业界已经在尝试这个方向。有少数领先的大模型,如DeepSeekR1、OpenAI o1,它们在GPQADiamond等难题上的表现,已经超过经过博士学术训练的人类。

R1 Zero和R1两个推理模型的区别:R1 Zero是更纯粹的RL-based Model,用DeepSeek自己的预训练模型V3,没有经过任何人类知识的调教,直接用一些数学或者代码的这类有明确“ground truth”(真实值,在机器学习和计算机视觉领域,指的是数据集中每个样本的真实标签或结果)的问题,做强化学习,得到了不错的结果。

DeepSeek v3 vs r1

假设用户想了解“AI如何应用于农业”。使用DeepSeek时:

- DeepSeek-v3可能会直接回答:“AI通过预测天气、病虫害以及自动化灌溉等方式提高农业生产效率。”

- DeepSeek-r1 则会在回答中加入更多细节,例如:“首先,收集历史气象数据……;其次,利用机器学习算法分析作物生长周期……。”R1相比R1 zero,用了更多工程化的方法,也加入了类似模仿学习的SFT(监督微调),进一步提升语言能力和全面性能,用户来说更好友好。《DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning》

Test-Time Compute方法:通过延长推理时间,来提高输出质量。模型不是直接输出结果,而是先推理出中间结果,随着推理时间的增加,最终结果的质量也会提升。核心的贡献是帮助强化学习