机器学习常用算法和模型 2

= RNN,循环神经网络

循环神经网络(Recurrent Neural Network,简称RNN)是一种专门用于处理序列数据的神经网络模型。与传统的前馈神经网络(如CNN)不同,RNN具有记忆能力,能够利用之前的时间步(Time Step)的信息来影响当前的输出,这使得它非常适合处理具有时间依赖性或顺序关系的数据,如自然语言、时间序列、语音信号等。

1. RNN的基本原理

循环神经网络的核心思想是引入时间维度,使得网络能够处理序列数据。RNN通过在每个时间步上接收输入,并结合之前时间步的信息(记忆)来生成输出。这种结构使得RNN能够捕捉序列中的动态变化和长期依赖关系。

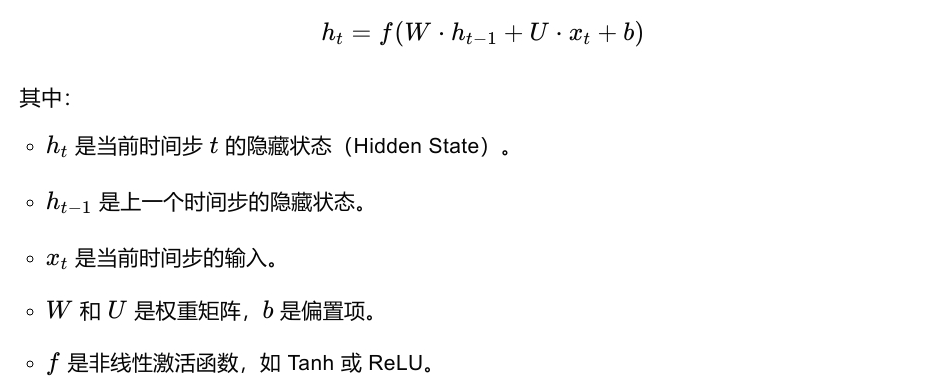

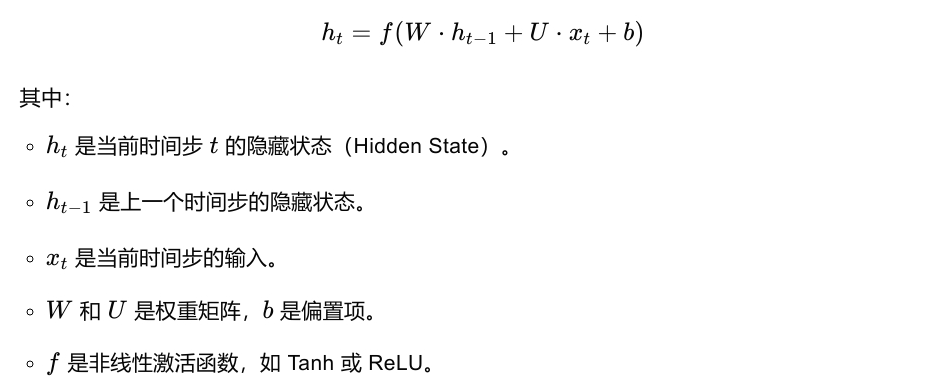

RNN的基本单元是循环单元(Recurrent Unit),其工作过程可以用以下公式表示:

状态更新公式:

输出公式:

2. RNN的结构

RNN的结构可以分为以下几部分:

(1)输入序列(Input Sequence)

输入序列是一个按时间顺序排列的数据,例如一个句子(每个单词是一个时间步)、时间序列数据(每个时间点是一个时间步)等。输入序列可以表示为 {x1,x2,…,x**T},其中 T 是序列的长度。

(2)隐藏层(Hidden Layer)

隐藏层是RNN的核心部分,它在每个时间步上接收输入,并结合之前的隐藏状态来更新当前状态。隐藏层的状态 h**t 是RNN的记忆单元,用于存储序列中的信息。

(3)输出层(Output Layer)

输出层根据隐藏层的状态生成最终的输出。输出可以是序列中的每个时间步的预测(如语言模型),也可以是整个序列的最终预测(如序列分类)。

3. RNN的训练过程

RNN的训练过程与传统的神经网络类似,但需要考虑时间维度。主要步骤包括:

(1)前向传播(Forward Propagation)

在前向传播中,输入序列逐时间步传递到网络中,每个时间步的隐藏状态和输出根据上述公式计算。

(2)损失函数(Loss Function)

损失函数用于衡量预测输出与真实标签之间的差异。对于序列任务,损失函数通常在每个时间步上计算,然后将所有时间步的损失累加。常见的损失函数包括:

- 交叉熵损失(Cross-Entropy Loss):用于分类任务。

- 均方误差(MSE):用于回归任务。

(3)反向传播(Backpropagation)

RNN的反向传播称为反向传播通过时间(Backpropagation Through Time,BPTT)。它将整个序列的损失对每个时间步的权重进行反向传播,更新网络参数。由于RNN的输出依赖于之前的隐藏状态,因此反向传播需要沿着时间维度展开。

4. RNN的变体

虽然RNN能够处理序列数据,但在实际应用中,它存在一些问题,如**梯度消失(Vanishing Gradient)**和**梯度爆炸(Exploding Gradient)**。为了解决这些问题,研究者提出了几种RNN的变体:

(1)长短期记忆网络(LSTM)

LSTM是一种改进的RNN结构,通过引入**门控机制(Gating Mechanism)**来解决梯度消失问题。LSTM的核心是**单元状态(Cell State)**,它能够长期存储信息,并通过三个门(输入门、遗忘门、输出门)控制信息的流动。

- 输入门(Input Gate):决定当前输入信息有多少被写入单元状态。

- 遗忘门(Forget Gate):决定单元状态中有多少信息被遗忘。

- 输出门(Output Gate):决定单元状态中有多少信息被输出。

LSTM的结构使得它能够有效地捕捉长期依赖关系,广泛应用于自然语言处理和时间序列预测任务。

(2)门控循环单元(GRU)

GRU是LSTM的简化版本,通过引入两个门(更新门和重置门)来控制信息的流动。GRU的结构比LSTM更简单,参数更少,训练速度更快,但在某些任务中表现与LSTM相当。

- 更新门(Update Gate):控制单元状态的更新程度。

- 重置门(Reset Gate):控制单元状态的遗忘程度。

GRU在许多自然语言处理任务中表现出色,尤其是在需要快速训练和较少参数的场景中。

5. RNN的应用场景

RNN及其变体(如LSTM和GRU)在以下领域有广泛应用:

(1)自然语言处理(NLP)

- 语言模型:预测下一个单词或字符。

- 机器翻译:将一种语言的文本翻译成另一种语言。

- 文本分类:情感分析、主题分类等。

- 问答系统:理解问题并生成回答。

(2)时间序列分析

- 股票价格预测:根据历史数据预测未来的股票价格。

- 天气预测:根据历史气象数据预测未来的天气情况。

- 设备故障预测:根据设备运行数据预测故障。

(3)语音识别

- 语音转文字:将语音信号转换为文字。

- 语音情感分析:识别语音中的情感。

(4)音乐生成

- 音乐创作:根据输入的旋律生成新的音乐片段。

6. RNN的优缺点

优点

- 处理序列数据能力强:能够捕捉序列中的动态变化和长期依赖关系。

- 灵活性高:适用于多种类型的序列数据(如文本、时间序列、语音)。

- 记忆能力:通过隐藏状态存储序列中的信息。

缺点

- 梯度消失和梯度爆炸问题:在长序列中,RNN的梯度可能会迅速消失或爆炸,导致训练困难。

- 训练速度慢:由于反向传播需要沿着时间维度展开,训练过程可能较慢。

- 难以捕捉非常长的依赖关系:尽管LSTM和GRU有所改进,但在极端情况下,仍然可能无法捕捉非常长的依赖关系。

GAN,生成对抗网络

生成对抗网络(Generative Adversarial Networks,简称GAN)是由Ian Goodfellow等人在2014年提出的一种深度学习模型,通过两个神经网络的对抗训练来生成逼真的数据。

GAN的核心原理

GAN由两个主要部分组成:

生成器(Generator):

- 输入:随机噪声(通常来自高斯分布或均匀分布)。

- 输出:生成的数据(如图像、文本等)。

- 目标:生成足够逼真的数据,以欺骗判别器。

判别器(Discriminator):

- 输入:真实数据或生成器生成的数据。

- 输出:一个概率值,表示输入数据是真实数据的可能性。

- 目标:尽可能准确地区分真实数据和生成器生成的假数据。

GAN的训练过程是一个极小极大博弈(Minimax Game):

- 生成器试图最大化判别器对其生成数据的误判概率。

- 判别器试图最大化对真实数据和生成数据的区分能力。

训练过程

GAN的训练分为以下步骤:

- 固定生成器,训练判别器:使判别器能够更好地区分真实数据和生成数据。

- 固定判别器,训练生成器:使生成器生成的数据更逼真,以欺骗判别器。

- 交替迭代:重复上述步骤,直到生成器生成的数据与真实数据分布接近。

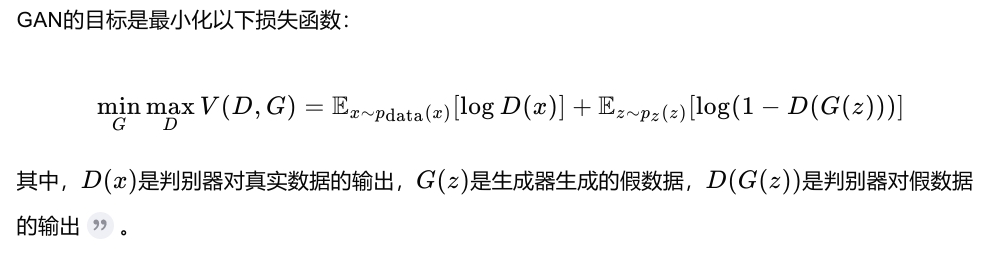

GAN的数学原理

GAN的应用

GAN在多个领域取得了显著成果,包括:

- 图像生成:生成逼真的图像。

- 图像编辑与风格迁移:对图像进行风格转换。

- 数据增强:生成额外的训练数据。

- 文本到图像合成:根据文本描述生成图像。

GAN的变体

GAN的变体包括:

- 条件生成对抗网络(cGAN):通过引入条件信息控制生成器的输出。

- CycleGAN:用于非配对图像到图像的转换。

GAN的优势与挑战

- 优势:强大的生成能力,能够学习数据的真实分布。

- 挑战:训练过程不稳定,可能出现模式崩溃(Mode Collapse)。

GAN的设计灵感来源于博弈论,通过生成器和判别器的对抗训练,不断优化生成数据的质量。